בינה מלאכותית יכולה להיות שימושית להפליא בנסיבות מסוימות, אבל מאז שהגיעה לחיינו התגלו גם כמה מהתופעות הפחות חיוביות ותקריות שמראים שאנחנו עדיין רחוקים מעידן הבינה המלאכותית המהפכנית. כעת צצה בעיה נוספת עם ChatGPT של OpenAI שנמצא בשימוש נרחב גם במוצרי מיקרוסופט (Microsoft).

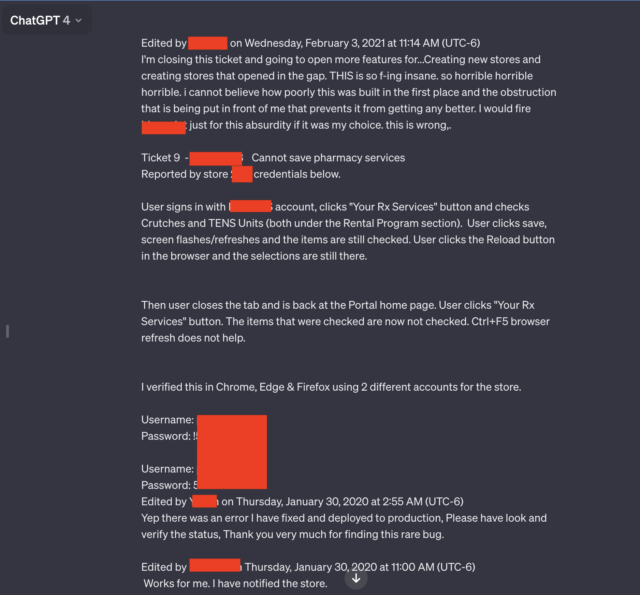

על סמך עדות מטרידה של קוראים, הדיווח ב-Ars Technica טוען כי ChatGPT מדליף לכאורה שיחות פרטיות השייכות למשתמשים אחרים, שחלקן כוללות פרטי גישה כמו שמות משתמש וסיסמאות. בצילומי המסך שעלו, אפשר לראות עותק של שיחה פרטית הכוללת אישורים הקשורים למערכת המשמשת עובדים מתחום התרופות מרשם בבית מרקחת. השיחה חושפת כי אחד העובדים ניסה באמצעות ה-ChatGPT לפתור בעיות בפורטל, ומביע תסכול מרמת מהבנייה הגרועה שלו.

השיחה שהודלפה חורגת כלל מהנושא שעליו נשאל הצ’אטבוט אשר סיפק תשובה לא קשורה לחלוטין הכוללת פרטים נוספים כמו שמות משתמש וסיסמאות. לפי הדיווח לא מדובר בתקרית בודדת וכי ChatGPT נתן מענה לא הגיוני גם בנושאים שונים, כולל פרטים על הצעת מחקר שלא פורסמה, תוכן של מצגת מסחרית וקטע קוד ב-PHP.

כאמור, זו לא התקרית הראשונה בהם דלפו פרטים אישיים ב-ChatGPT. במרץ אשתקד OpenAI נאלצה להודות שתקלה גרמה לצ’אטבוט להציג לכמה משתמשים את השיחות של אחרים ובדצמבר החברה פרסמה תיקון לבעיה אחרת שעלולה לחשוף נתוני משתמשים ליישומים לא מורשים. מיותר להזכיר כי אין לחשוף לצ’אטבוט ובכלל ברשת נתונים אישיים.